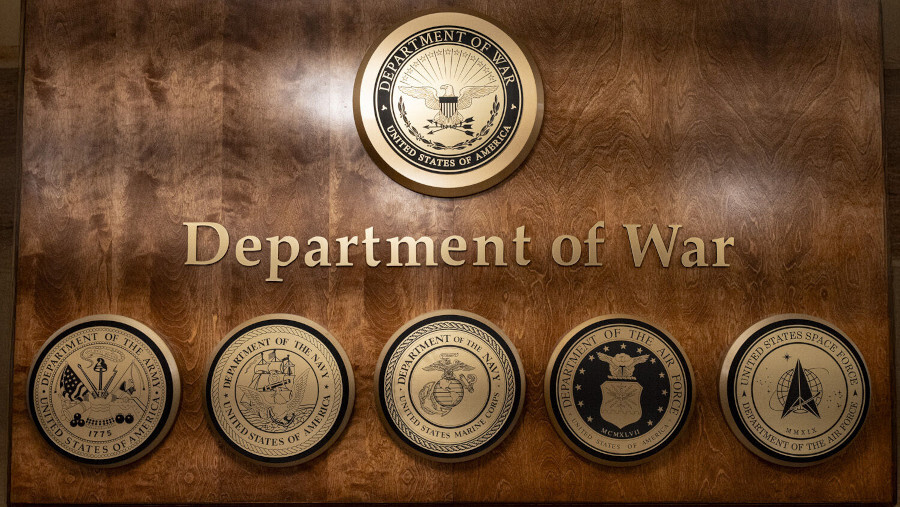

Celal Gunes/Anadolu via Getty Images

La guerra por la guerra de la IA

La inteligencia artificial desempeñó un papel crítico en la misión militar de Estados Unidos en Venezuela en enero y lo está haciendo nuevamente en Irán. También está transformando el campo de batalla en Ucrania a diario. El Pentágono cree que esto le dará a Estados Unidos la ventaja necesaria para mantenerse a la vanguardia, sin embargo las disputas legales lo están frenando.

Para Estados Unidos, es una cuestión de seguridad nacional.

Regulando el poder

En enero, las fuerzas de operaciones especiales de EE UU al parecer utilizaron la IA Claude de Anthropic en asociación con Palantir para capturar al presidente venezolano Nicolás Maduro.

Cuando el Departamento de Guerra no pudo responder satisfactoriamente a una consulta de Anthropic sobre la operación militar, la asociación comenzó a desmoronarse. En lugar de responder preguntas, el Departamento de Guerra pasó a la ofensiva, buscando menos restricciones para el uso de la IA Claude en la guerra.

En una carta del 9 de enero, el Departamento de Guerra explicó que debe poder “utilizar modelos libres de restricciones de políticas de uso que puedan limitar aplicaciones militares legales”. Declaró: “En el ámbito de la seguridad nacional, la guerra basada en IA y el desarrollo de capacidades basadas en IA redefinirán el carácter de los asuntos militares en la próxima década. (...) El ejército de Estados Unidos debe consolidar su liderazgo sobre nuestros adversarios en la integración de esta tecnología, establecida durante el primer mandato del presidente Trump, para hacer que nuestros combatientes sean más letales y eficientes”.

Pero para el director ejecutivo de Anthropic, Dario Amodei, la falta de información sobre cómo se está utilizando su IA Claude en operaciones militares, junto con esta exigencia, fue demasiado.

El 26 de febrero, dijo que, dado “el significativo valor que la tecnología de Anthropic proporciona a nuestras fuerzas armadas”, esperaba que el Pentágono reconsiderara su exigencia de uso sin restricciones de su modelo de IA Claude. Sin embargo, Amodei tenía dos preocupaciones: la posibilidad de que la IA se usara en la vigilancia masiva de los estadounidenses o en armas totalmente autónomas.

En este sentido, el contrato modificado propuesto por el Pentágono “no hizo prácticamente ningún progreso en prevenir el uso de Claude para la vigilancia masiva de estadounidenses o en armas totalmente autónomas”, dijo Amodei. Por eso, su empresa “no puede, en conciencia, acceder” a las demandas del Pentágono.

El Secretario de Guerra, Pete Hegseth, amenazó a Anthropic con que, si no autorizaba el uso militar sin restricciones, se arriesgaría a perder su contrato con el gobierno. Otros oficiales militares amenazaron con designar a la empresa como un riesgo para la cadena de suministro o invocar una ley de la era de la Guerra Fría que le daría al ejército la autoridad para usar Claude.

Amodei respondió diciendo: “Estas dos últimas amenazas son inherentemente contradictorias: una nos tacha de riesgo para la seguridad; la otra considera a Claude como esencial para la seguridad nacional”. La administración Trump luego designó a Claude como un riesgo para la cadena de suministro y ordenó que el gobierno dejara de usarlo. Por cierto, la disputa provocó a un aumento en la popularidad de la IA Claude.

Anthropic y el Departamento de Guerra se separaron, y OpenAI vio una oportunidad; firmaron contratos el viernes 27 de febrero.

Aunque OpenAI afirma que sus contratos tienen más garantías que los de Anthropic, algunos creen que permite el uso “legal” de la vigilancia masiva y armas controladas por la IA.

No pasó mucho tiempo antes de que el director ejecutivo de OpenAI, Sam Altman, comenzara a retractarse. “No deberíamos habernos apresurado a publicar esto el viernes”, escribió Altman el lunes 2 de marzo por la noche. "Los temas son sumamente complejos y requieren una comunicación clara. Estábamos tratando genuinamente de desescalar las cosas y evitar un resultado mucho peor, pero creo que simplemente pareció oportunista y descuidado”. Agregó que OpenAI está renegociando el acuerdo.

Por supuesto, las empresas de IA en China nunca impondrían tales restricciones al régimen chino, lo que plantea la cuestión de la capacidad de Estados Unidos para mantener el liderazgo en el uso de la guerra de la IA.

Todavía se usa en Irán

El presidente de Estados Unidos, Donald Trump, calificó a Anthropic como una “empresa de inteligencia artificial de izquierda radical dirigida por personas que no tienen idea de lo que es el mundo real”.

Sin embargo, el Wall Street Journal y Axios informaron que, justo después de que el presidente declarara que el gobierno federal ya no usaría Anthropic, su ejército lo usó en el ataque a Irán.

Hegseth explicó: “Anthropic continuará prestando sus servicios al Departamento de Guerra por un período no superior a seis meses para permitir una transición sin problemas”.

A pesar de las disputas y preocupaciones, la IA está desempeñando un papel cada vez más importante en la guerra.

Los sistemas de IA se utilizan para analizar grandes cantidades de datos para evaluar la inteligencia, luego ayudan a identificar y priorizar objetivos, simular ataques y predecir resultados.

El Jerusalem Post comentó el 3 de marzo que la IA en Irán “dejó de ser una herramienta analítica de apoyo administrativo y se ha integrado operativamente en la toma de decisiones en el campo de batalla y la planificación de la guerra”.

Esta es sólo una de las muchas formas en que el uso de la IA impacta en el campo de batalla. Si se combinara con el uso de sistemas de armas totalmente autónomos controlados por IA, la IA podría utilizarse para ejecutar sus propios planes.

Pero hay preocupaciones. El Times informó:

En las primeras 24 horas de la Operación Furia Épica, el ejército estadounidense atacó más de 1.000 objetivos en Irán con la ayuda de inteligencia artificial.

Dada la tasa de 42 objetivos sugeridos por hora, los expertos se han preguntado si las máquinas están ahora a cargo en el campo de batalla porque el cerebro humano no puede seguir el ritmo.

Han planteado la posibilidad de que la inteligencia artificial haya identificado erróneamente la escuela primaria en Minab el primer día de la guerra. Cada vez hay más pruebas de que Estados Unidos disparó lo que parecen haber sido misiles de crucero Tomahawk contra el sitio, matando a 110 niños y docenas de personas más.

El artículo cita a Noah Sylvia, analista de investigación del Royal United Services Institute, que afirma: “Si el bombardeo de la escuela fue un error, ¿fue un error humano o la velocidad de automatización del sistema? ¿Se basó en datos antiguos? ¿Fue una máquina que lo hizo automáticamente? El número de ataques que estamos viendo da cierta credibilidad a la idea de que los objetivos se crean en gran medida de manera autónoma”.

La escuela fue alguna vez parte de un complejo del Cuerpo de la Guardia Revolucionaria Islámica, pero ha estado separada por al menos nueve años. Sin embargo, si el sistema de IA utilizó imágenes satelitales más antiguas, habría concluido que se trataba de un objetivo militar. El Dr. Craig Jones, profesor titular de geografía política en la Universidad de Newcastle, concluyó: “En este punto no podemos descartar que la IA pueda haber (...) fallado en identificar la escuela como tal, y en su lugar, la haya identificado como un objetivo militar”.

Por ahora, todo esto es especulación. Pero tan sólo pensar que un error de la IA pudiera haber causado la muerte de más de 100 niños muestra la aterradora realidad en la que vivimos.

Mientras muchos temen darle demasiado poder a la IA, otros temen que limitarla permitirá que otros tomen la delantera. Este es el dilema que el gerente de redacción de la Trompeta, Joel Hilliker, explicó en “Por qué debemos desarrollar la IA (aunque nos mate)”.

“La IA está creando una carrera armamentista similar a la que impulsó la proliferación nuclear. Lo que está en juego no es sólo el prestigio tecnológico, sino también influencia geopolítica y ventaja militar”, escribió.

Pero, ¿continuará la IA proporcionando a Estados Unidos la ventaja militar necesaria?

Por qué la IA no ganará las guerras de Estados Unidos

La IA parece prometer menos bajas humanas, ataques más precisos y victorias más fáciles. Sin embargo, la Biblia advierte que la confianza en la tecnología está mal depositada. Como escribimos en “Por qué la tecnología estadounidense no puede ganar guerras”:

Estados Unidos carece de la voluntad y la determinación para ganar un enfrentamiento importante. La ciencia y la tecnología intentan hacer frente a las consecuencias.

El objetivo es permitir que una nación dividida y escéptica gane una victoria parcial a bajo costo. Pero para que Estados Unidos vuelva a ser grande verdaderamente, la nación debe abordar la causa.

La falta de voluntad de Estados Unidos es una enfermedad del espíritu. Tiene que ver con la psique humana y no se puede solucionar mediante la experimentación científica.

La Biblia lo explica claramente.

Dios dice: “quebrantaré la soberbia de vuestro orgullo…” (Levítico 26:19). Dios y Sus bendiciones fueron la verdadera fuente de la fuerza, la prosperidad e incluso la ventaja tecnológica de Estados Unidos. Pero la nación no Le ha obedecido, por lo que su unidad y espíritu de lucha han sido quebrantados. Esa ventaja tecnológica ha permitido que un Estados Unidos de voluntad débil se mantenga como una gran potencia durante décadas. Pero no ha traído victorias significativas.

La advertencia está en la pared: Los avances tecnológicos sólo han aumentado la confianza de Estados Unidos en sí mismo y lo han alejado cada vez más de Dios. Como explica “Por qué la tecnología estadounidense no puede ganar guerras”, esto será su perdición.